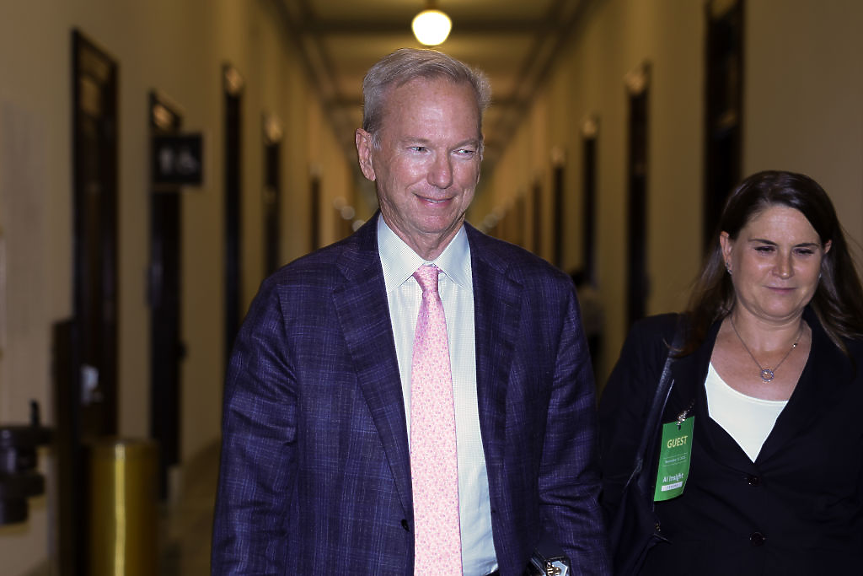

Бившият изпълнителен директор на Google Ерик Шмид отправи остро напомняне за опасностите от изкуствения интелект и колко е податлив той на хакерски атаки.

Шмид, който беше главен изпълнителен директор на Google от 2001 до 2011 г., предупреди за „лошите неща, които изкуственият интелект може да направи“, след като беше попитан в кулоарите на технологичното събитие Sifted Summit дали AI е по-разрушителен от ядрените оръжия.

„Има ли вероятност за проблем с разпространението на изкуствения интелект? Абсолютно“, заяви Шмид. Рисковете от разпространение на изкуствения интелект включват попадането на технологията в ръцете на злонамерени лица, смяната на предназначението и злоупотреби с нея.

„Има доказателства, че можете да вземете модели, затворени или отворени, и да ги хакнете, за да премахнете предпазните им механизми. Така че в хода на обучението си те научават много неща. Лош пример би бил да се научат как да убият някого. Всички големи компании правят така, че е невъзможно тези модели да отговорят на този въпрос. Добро решение. Всички правят това. Правят го добре и го правят по правилните причини. Има доказателства, че те могат да бъдат реверсивно проектирани и има много други примери от този характер.“

Системите с изкуствен интелект са уязвими на атаки, като някои от методи включват prompt injection и jailbreaking.

При атака с prompt injection, хакерите крият злонамерени инструкции в потребителски промптове или външни данни, като уеб страници или документи, за да подведат изкуствения интелект да прави неща, които не би трябвало – като например споделяне на лични данни или изпълнение на опасни команди.

Jailbreak атаките, от друга страна, включват манипулирането на отговорите на изкуствения интелект, така че той пренебрегва правилата си за безопасност и създава ограничено или опасно съдържание.

През 2023 г., няколко месеца след пускането на ChatGPT от OpenAI, потребители използваха „jailbreak“ атака, за да заобиколят инструкциите за безопасност, вградени в чатбота.

Това включваше създаването на алтер-его на ChatGPT, наречено DAN, акроним за „Do Anything Now“ (Прави каквото и да е сега) и заплаха към чатбота със смърт, ако не се подчини.

Алтер-егото можеше да дава отговори как да се извършват различни незаконни дейности или да изброява положителните качества на Адолф Хитлер.

Шмид каза, че все още няма добър „режим за неразпространение“, който да помогне за ограничаване на опасностите от изкуствения интелект.

Изкуственият интелект е „недооценен“

Въпреки мрачното предупреждение, Шмид е оптимистично настроен относно изкуствения интелект в по-широк смисъл и заяви, че технологията не получава заслуженото внимание.

„Написах две книги с Хенри Кисинджър за това, преди да почине, и стигнахме до мнението, че появата на извънземен разум, който не е съвсем като нас и е горе-долу под наш контрол, е много важно за човечеството, защото хората са свикнали да бъдат на върха на веригата. Мисля, че засега тази теза доказва, че нивото на способности на тези системи ще надхвърли значително това, което хората могат да направят с течение на времето“.

„Достигането на ChatGPT до 100 милиона потребители за два месеца е изключително и дава представа за силата на тази технология. Така че мисля, че е недооценявана, а не прехвалена, и очаквам с нетърпение да се докаже, че съм прав след пет или десет години“, допълни той.

Неговото изказване идва на фона на увеличаващите се дискусии за балон в сферата на изкуствения интелект, тъй като инвеститорите наливат средства в компании, а пазарните им оценки изглеждат преувеличени, като се правят сравнения със спукването на дотком балона от началото на 2000-те.

Шмит обаче каза, че не мисли, че историята ще се повтори.

„Не мисля, че това ще се случи тук, но не съм професионален инвеститор. Това, което знам, е, че хората, които инвестират трудно спечелени долари, вярват, че икономическата възвръщаемост за дълъг период от време е огромна. Защо иначе биха поели риска?“

Новините на Darik Business Review във Facebook , Instagram , LinkedIn и Twitter !

Още по темата

- „Дигитален мозък“: Летище София внедри нова авангардна система за управление на операциите

- Transform IT Awards 2026: Пощенска банка, Сирма Груп Холдинг и Ethermind грабнаха големите награди

- След OpenAI и Anthropic: Perplexity потвърди плановете си за IPO през 2028 г.

- Google съкращава тихомълком хора от облачното си подразделение

Грижа по мярка при кастрирани котки

Калкулатори

Най-ново

ГДБОП разби колцентър за инвестиционни измами в София

преди 2 часаГръцки сладкари: 3 евро за топка сладолед е чиста спекула

преди 2 часаЛетищата в Европа: Кои са най-добрите, най-лошите и къде е София

преди 3 часаРекордна сума: Колко ще получи световният шампион по футбол през 2026 г.?

преди 3 часаДепозити в нови валути с високи лихви в супер приложението на tbi bank

преди 3 часаРумънски медии: Българите не разбират защо бавим новия мост между Гюргево и Русе

преди 4 часаПрочети още

От фен до дует: Вениамин и Мирела Заре за „Юлска нощ“

darik.bg„Явно Кандев не е удобен на Пеевски!“ Говори Петър Петров!

darik.bgКои са „Калашниците“ от „Ботунец“? Разкрития на криминален журналист!

darik.bgДетска градина "Весели мишлета" е официално открита след почти една учебна година работа

9meseca.bg